Bewiesene Genauigkeit

Lasertriangulation mit Scanraten von bis zu 40kHz

Voraussetzung für Kameras zur schnellen Lasertriangulation ist die Kombination eines Bildsensors, der mit hoher Geschwindigkeit Bilddaten aufnehmen kann, mit einer subpixelgenauen Berechnung der Position der Laserlinie in Echtzeit. Durch eine Echtzeitauswertung der Bilddaten in der Kamera, wird die zum Bildverarbeitungssystem übertrage Datenmenge deutlich reduziert. Dadurch ist die Realisierung kostengünstiger und robuster Triangulationssysteme mit mehreren Kameras möglich.

Bild 1: Mit der Kamera MV1-D1280-L01-3D05-1280-G2 können bei der Lasertriangulation Scanraten über 40.000fps bei einer Auflösung von 1.280×16 Pixeln bzw. knapp 70.000fps mit 768×16 Pixeln erzielt werden. (Bild: Photonfocus AG)

Mit CMOS Bildsensoren, wie z.B. dem Lux1310 von Luxima, die speziell für die Bewegungsanalyse optimiert wurden, stehen schnelle Sensoren zur Verfügung, die durch Anpassung des Auslesefensters (ROI) Bilddatenraten über 40.000fps zulassen. Die Kameras besitzen dank integrierter FPGAs breitbandige Schnittstellen. Zugleich ermöglicht der FPGA-Einsatz die Echtzeitverarbeitung der Bilddaten und die Implementierung der Systemschnittstellen. Die Bildverarbeitung in den FPGAs der Kamera stellt den Nutzer allerdings vor die Problematik, dass er die Rohbilder nicht bewerten kann, d.h. er muss den Ergebnissen der Bildvorverarbeitung blind vertrauen. Diesem Nachteil kann man begegnen, indem Qualitätsparameter für jeden Messpunkt übertragen werden und belastbare Aussagen über die Genauigkeit und Robustheit der Algorithmen zur Bestimmung der Linienposition zur Verfügung gestellt werden. Photonfocus hat gleich zum Beginn der Einführung der Produktserie für Lasertriangulationsapplikationen zwei Qualitätsmerkmale, die Intensität und Halbwertsbreite des Linienprofils definiert, die zusammen mit der berechneten subpixelgenauen Position übertragen werden oder bereits in der Kamera zur Ausfilterung von Fehlern genutzt werden.

Verlässliche Datensätze dank Eichkörper

Aussagen über die Genauigkeit und Robustheit von Algorithmen zur Bestimmung der Linienposition kann man anhand von Untersuchungen an realem Bildmaterial oder aus Simulationen gewinnen. Bei Untersuchungen an realen Objekten muss allerdings die wirkliche Geometrie der Körper bekannt sein, damit Genauigkeitsaussagen getroffen werden können. Durch die Anfertigung entsprechender Eichkörper und Werkstücke und die Vermessung mit taktilen Messsystemen und kalibrierten optischen Messgeräten wurden verlässliche Datensätze generiert, mit denen die zu untersuchenden Verfahren bewertet wurden. Zur Simulation wurden Gaussprofile oder asymmetrische Verteilungen verwendet, die mit unterschiedlichen Rauschanteilen, z.B. Speckle-Rauschen, versehen wurden. Im Gegensatz zu den Messungen an realen Körpern kann in der Simulation die Position des Lichtschnittes in den Testbildern vorgegeben werden. Ein weiterer Aspekt bei der Lasertriangulation ist das Signal-Rausch-Verhältnis (SNR) in den Rohbildern, dass durch das Speckle-Rauschen des Laserliniengenerators und das SNR des CMOS vorgegeben ist. Das Speckle-Rauschen des Laserliniengenerators tritt beim Scanvorgang oft in den Hintergrund, da über eine relativ lange Wegstrecke integriert wird. Erst bei hohen Scanraten, und den damit verbundenen kurzen Belichtungszeiten, tritt das Speckle-Rauschen deutlicher hervor. Störend wird es bei ruhenden Werkstücken/Scannern wahrgenommen, was die Abnahme von 3D-Laserlichtschnittsystemen behindert. Das SNR von Bildsensoren ist direkt an die Full-Well-Kapazität des Sensors gekoppelt, sodass für ein gutes SNR die Bildsensoren mit einer hinreichend hohen Full-Well eingesetzt werden müssen. Um eine hohe Full-Well ausnutzen zu können, benötigt man leistungsstärkere Laserliniengeneratoren und kann bezüglich der Augensicherheit an Grenzen stoßen. Der Lux1310 Sensor mit 17ke- Full-Well und einem SNR von 42dB ist diesbezüglich ein guter Kompromiss. Das im Sensor implementierte HDR-Verfahren erweitert zusätzlich den Dynamikbereich und reduziert Sättigungseffekte bei der Bildaufnahme.

Gute Simulationsergebnisse

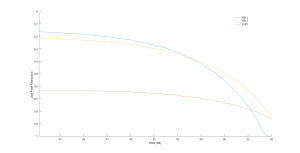

Bild 2: Subpixelgenauigkeit des COG Algorithmus und zweier FIR-Filter Algorithmen in Abhängigkeit des SNR für ein durch Speckle verrauschtes Gaussprofil (oben) und Weibullprofil (unten) der Halbwertsbreite 7. (Bilder: Photonfocus AG)

Zur Abschätzung des Einflusses des SNR auf die Subpixelgenauigkeit der implementierten Algorithmen wurden Monte-Carlo-Simulationen durchgeführt und mit den aus den Rohdaten berechneten Ergebnissen verglichen. Der Übersichtlichkeit halber zeigt Bild 2 oben beispielhaft das Simulationsergebnis der Subpixelgenauigkeit in Abhängigkeit des SNR für ein, durch Speckle-Rauschen verrauschtes, Gaussprofil mit der Halbwertsbreite von 7 Pixeln für den COG-Algorithmus und zwei FIR-Filter Implementierungen. In den Simulationen schneidet das COG Verfahren bei symmetrischen Linienprofilen überwiegend besser ab als die FIR-Filter. Dagegen zeigt der COG-Algorithmus in Bild 2 unten wie erwartet bei asymmetrischen Linienprofilen deutliche Abweichungen. Die Ergebnisse der Simulationen sind in guter Übereinstimmung mit den Erfahrungswerten aus realisierten Applikationen. Mit der Kamera MV1-D1280-L01-3D05-1280-G2 können Scanraten über 40.000fps bei einer Auflösung von 1.280×16 Pixeln bzw. ca.70.000fps mit 768×16 Pixeln erzielt werden. In der Kamera ist ein COG Algorithmus implementiert. Die Kamera verfügt über ein Drehgeberinterface und lässt sich durch das GigEVision-Interface effizient in Bildverarbeitungssysteme implementieren.