Arbeitsverteilung

3D-Smart-Sensoren sorgen für schnelleres Edge Computing

Schnellere 3D-Smart-Sensoren verbessern die Reaktionszeit beim Edge Computing und reduzieren die Latenzzeit auf Millisekunden, bei gleichzeitiger Optimierung der Netzwerkbandbreite.

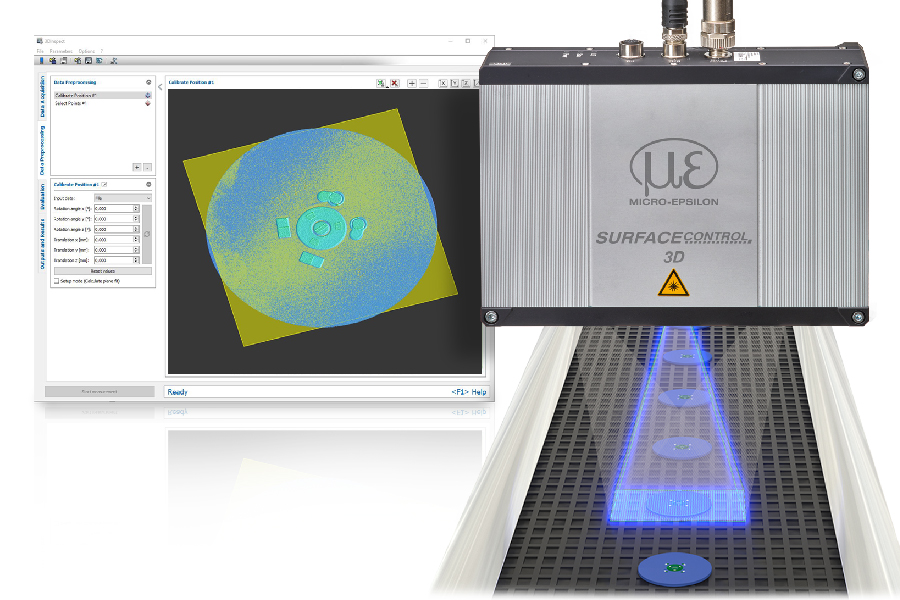

Die GoMax Hardware entlastet die Gocator Sensoren, ohne dass ein Industrie-PC benötigt wird. Das Gerät verbindet sich direkt mit jedem 3D-Smart-Sensor und übernimmt einen Teil der Datenverarbeitung. (Bild: LMI Technologies GmbH)

In der modernen Fertigung werden relevante Produktionsdaten direkt von der Fertigungslinie gemeldet und verarbeitet, um Qualitätsstandards zu sichern, die Automatisierung zu steuern und individuelle Modellanpassungen zu ermöglichen. Daher nutzen viele Hersteller Industrie 4.0 Konzepte und setzen vernetzte, intelligente Geräte ein. Diese Geräte verwenden Messdaten für die Steuerung von automatisierten Prozessen oder die Planung einer bedarfssynchronen Produktion (Produkte auf Abruf). Smarte Sensoren übernehmen – dank immer höherer Rechengeschwindigkeiten – auch die Verarbeitung von Rohdaten direkt in der Fertigung und reduzieren so die Datenbelastung, melden wichtige Ergebnisse und beliefern eCommerce-Systeme mit Echtzeitinformationen.

Schnellere Datenverarbeitung

In der Fertigung werden bisher meist 2D-Visionsysteme verwendet, die auf FPGAs basieren, und Rohbilddaten zur Qualitätskontrolle an lokale PCs senden. Intelligente Kameras verwenden einen Prozessor und einen FPGA, um die Rohdaten bereits innerhalb des Geräts für einfache Inspektionsaufgaben zu verarbeiten. Mit einer steigenden Kameraauflösung von VGA auf 10 bis 25MP, verlangsamen sich allerdings die Zykluszeiten drastisch und es wird eine höhere Verarbeitungsgeschwindigkeit benötigt. Hier kommen zunehmend Grafikprozessoren (GPU) ins Spiel. In dedizierten Hardwaregeräten mit GPU-Beschleunigung, wie der Nvidia Jetson TX2 oder Intel Movidius, läuft die Entscheidungslogik auf einem für Multithreading optimierten ARM-Prozessor ab. Der rechenintensive Teil der Anwendung läuft parallel auf hunderten von GPU-Recheneinheiten. Mit Technologien wie CPU, FPGAs oder GPU können mittlerweile Auflösung und Geschwindigkeit von Bildverarbeitungssystemen mit den heutigen Produktionszykluszeiten mithalten. Auch 3D-Sensoren verfügen inzwischen über die genanten Technologien, die für die Beschleunigung der Systeme notwendig sind. Das Ergebnis ist eine leistungsstarke Datenverarbeitung am äußeren Rande des Netzwerkes, also dort wo die Quelle der Daten liegt, um IO/NIO-Entscheidungen zu treffen. Dadurch ist es möglich, große Mengen von Fertigungsdaten in kleinere, überschaubare Pakete zu verarbeiten, zu analysieren und zu bearbeiten.

Verteilte und skalierbare Netzwerkarchitekturen

Smart-Sensor-Netzwerke stützen sich auf eine verteilte Netzwerkarchitektur und sind skalierbar. Somit können Nutzer spezifische Mess- und Steuerungslösungen für jede Fertigungszelle entwickeln. Anwendungen werden durch das Laden von Jobdateien über das Produktionsnetzwerk implementiert. Diese Dateien konfigurieren Messungen, führen Edge-Geräte aus und erfordern minimale Interaktion mit koordinierenden Elementen. Die Datenverarbeitung wird also beschleunigt, indem unnötige oder unerwünschte Uploads auf Server in zentralen Rechenzentren vermieden werden. Ein intelligenter Sensor erfasst nicht nur Daten, sondern verarbeitet die Daten weiter und kommuniziert Steuerungsentscheidungen an das Produktionsnetzwerk – direkt vom Rand des Netzwerkes, ohne das Daten an einen zentralen Ort übermittelt werden müssen. Dadurch ist der Sensor in der Lage, das Speichern und Verarbeiten von Daten auf dem Sensor selbst durchzuführen, so dass ausgewählte Anwendungen lokal und mit hohen Geschwindigkeiten ausgeführt werden können. Das dies keine Vision mehr ist, zeigt GoMax. Die Hardware entlastet die Gocator 3D-Smart-Sensoren, um die geforderten Inline-Produktionsgeschwindigkeiten zu erreichen, ohne dass ein Industrie-PC benötigt wird. Das Gerät verbindet sich dabei direkt mit jedem Sensor und übernimmt einen Teil der Datenverarbeitung, inkl. Punktwolkenerzeugung, 3D-Messung und SPS/Roboter-Kommunikation. So werden kleinere Datenpakete an die Produktion übermittelt, anstatt kontinuierlich Rohscandaten für die Datenverarbeitung an anderer Stelle zu übertragen. Diese Fähigkeit verringert den Druck auf die Netzwerkbandbreite, minimiert die Latenz und beschleunigt die Inspektionsraten.