OPC UA für Machine Vision?

Expertenrunde SPS und Bildverarbeitung

Bereits 2014 wurde auf der SPS IPC Drives über das Thema Bildverarbeitung und SPS diskutiert und was dazu notwendig sei, damit beide Welten zusammen wachsen (s. inVision 1/15, S.23ff). Auf der SPS IPC Drives 2015 hat inVISION dann nochmals auf dem VDMA-Forum nachgefragt, wie es inzwischen mit der Beziehung beider Technologien aussieht, und wie eine Kommunikation zwischen den Welten stattfinden könnte. Dabei kam es zu interessanten Ausblicken über die gemeinsame Zukunft. Stark im Fokus beider Seiten: OPC UA.

Warum sind die Welten Bildverarbeitung und Steuerungen immer noch getrennt?

Gehlen: Anfang der 90er Jahre waren die Anfänge der Bildverarbeitung. In dieser Zeit war die Rechenleistung der begrenzende Faktor für die Bildverarbeitung und eine SPS konnte diese Leistung nicht bereitstellen. Zudem war es die Zeit der Analogtechnik – Bilder mussten effizient zu einem Rechner übertragen und digitalisiert werden. Bis vor fünf Jahren haben uns diese Themen geprägt, sodass von Seiten der Bildverarbeitungshersteller eine SPS ausschließlich als Bindeglied für die Automatisierung wichtig war.

Schönegger: Ich glaube, dass beide Welten gar nicht so weit auseinander liegen, wie es den Eindruck erweckt. Wir haben z.B. bereits seit einigen Jahren Lösungen geschaffen, die es möglich machen, alles aus einer Hand zu bekommen. Ob dies bedeutet, dass alles auf derselben Rechnerarchitektur läuft, spielt erst einmal keine Rolle. Was zählt, ist Usability und Integration.

Munkelt: Hardware ist ein wichtiger Punkt, weil wir vor ein paar Jahren noch die Situation hatten, dass wenig Rechenpower auf der SPS-Seite gefordert war, aber viel auf Seiten der Bildverarbeitung. Heute haben wir Hardware, die wesentlich kostengünstiger ist, genügend Rechenpower für die Bildverarbeitung bereitstellt und zudem genügend Platz für die SPSler lässt.

Hoppe: Also ich glaube, dass Steuerungshersteller inzwischen Bildverarbeitung in die SPS integriert haben bzw. auf dem Weg dorthin sind. Letztlich reden wir irgendwann über funktionelle Softwaremodule, also Funktionalitäten, die in Hardware gegossen, extern laufen oder in einer SPS integriert sind. Wir kommen dann aber relativ zügig auf Schnittstellenthemen und wie man beide Seiten mit wenig Aufwand miteinander verheiraten kann. Es gibt heute bereits intelligente Kameras, die man aus einer SPS aufrufen kann, diese eine Bildauswertung machen und das Ergebnis dann in die SPS zurückschicken.

Schönegger: Das Problem liegt mehr in der Software, als in der Rechenarchitektur. Wir haben schon seit Jahren die Möglichkeiten, selbst in vermeidlich physikalisch kleinen SPSen Rechenpower zu integrieren, aber der Schlüssel ist die Softwareintegration.

Wie viel Ahnung muss der heutige SPS-Programmierer von Bildverarbeitung haben?

Hoppe: Ich habe in der Vergangenheit bereits selber ein Projekt betreut, wo eine Firma eine intelligente Kamera hergestellt hat, in die man OPC UA integriert hat. Aus der Steuerung heraus konnte man dann über einen genormten PLC Open OPC UA Client-Funktionsbaustein die Kamerafunktionalität abrufen, d.h. einen standardisierten Aufruf über ein standardisiertes Protokoll in eine intelligente Kamera gab es schon, er muss nur noch semantisch standardisiert werden. Ein SPS-Programmierer, der diese Funktionalität aufruft, muss daher von der Kamera relativ wenig wissen. Er muss nur wissen, wie er einen Funktionsbaustein aufruft und welche Parameter er zurück bekommt. Die Details, wie die Kamera das intern macht, muss er nicht verstehen.

Schönegger: Die klassischen Automatisierer sind das Arbeiten mit Funktionsblöcken und einfachen PLC Open-Bausteinen gewohnt. Was ein Problem darstellt, ist die eigentliche Bildverarbeitungsapplikation: Das, was man messen, prüfen oder auswerten will, ist heute noch bei vielen Bildverarbeitungssystemen ein sehr komplexer Prozess, der ein komplexes Know-how erfordert und sehr oft das Hinzuziehen von Systemintegratoren benötigt.

Gehlen: Nehmen wir z.B. einen Barcode-Leser. Dies ist ein Sensor, der das Bild eines Codes liest und in Textzeichen wandelt. Dieser Sensor ist ein integriertes Bildverarbeitungssystem, dass weiterhin über Schnittstellen mit einer SPS kommuniziert. Auf der anderen Seite haben wir aber auch hochkomplexe Systeme, wie Druckbildkontrollen oder Robot-Vision-Anwendungen, die auf einer Sensor- oder SPS-Ebene nicht mehr umsetzbar sind.

Noffz: Da die Rechenleistungen stark gestiegen sind, sind wir inzwischen in der Lage Dinge zu machen, für die man früher große Systeme brauchte. Dies kann jetzt bereits auf relativ kompakten Kameras erfolgen, die dank Embedded Vision eine erheblichere Rechenleistung haben. Allerdings brauchen wir für die Automatisierer eine Software und Ansteuerung mit einfacher Bedienbarkeit.

Schönegger: Man kann heute einfache Dinge bereits sehr einfach umsetzen, aber für komplexe Anwendungen braucht man Spezialisten? Dem kann ich nicht zustimmen. Man muss die Usability der Systeme verbessern und Ziel muss dabei sein, 100% der Bildverarbeitungsanwendungen zu lösen. Ziel muss es aber auch sein, komplexe Themen beherrschbar zu machen. Da stehen auch die Steuerungshersteller in der Verantwortung, ihren Kunden die Bildverantwortung innerhalb ihrer Systemlösungen zugänglich zu machen. Das dies möglich ist, zeigt die erfolgreiche Integration der Robotersteuerung in die Maschinensteuerung. Man kann mittlerweile mit einfachsten Methoden aus einer Steuerung heraus einen Roboter bedienen und mit einer Bildverarbeitung soll das nicht funktionieren?

Hoppe: Vor 20 Jahren gab es noch für jede Funktionalität eine eigene Hardware: Den Controller für die Achsfunktionalität, die SPS für die Logik, den Visualisierungs-PC und jeder Roboter hatte seine eigene Steuerung. Diese ganzen Funktionalitäten sind mittlerweile in die SPS gewandert. Heute brauchen sie zwar weiterhin einen Motion-Spezialisten, der das letzte Optimum aus dem jeweiligen Profil heraus holt, aber die Funktionalität wird in der SPS gerechnet. Warum soll dann nicht auch die Bildverarbeitung in eine SPS rein wandern?

Munkelt: Sofern man alles in einen billigen ´Block´ bekommt, bei dem ein Bild reinkommt und hinten ein String raus, ist alles gut. Aber so ist die Wirklichkeit nicht. Es gibt kein System, wo Sie ein Bild einlesen und dann für Sie analysiert wird, welche Schriftzeichen in dem Bild gelesen worden sind. Somit müssen Sie das Bild irgendwie vor-verarbeiten. Diese beschreibende Tätigkeit muss der Automatisierer machen. Die Bildverarbeitung hat es leider noch nicht geschafft, Systeme so zu vereinfachen, dass deren Usability einfach genug ist. Wir müssen zukünftig von der Usability in der Lage sein, das so zu präsentieren, dass es intuitiv zu bedienen ist. Sie haben alle für ihr Smartphone keine Schulung gehabt oder ein Handbuch gelesen. Genau dahin müssen wir kommen, alles so einfach zu machen, wie eine App auf ihrem Smartphone.

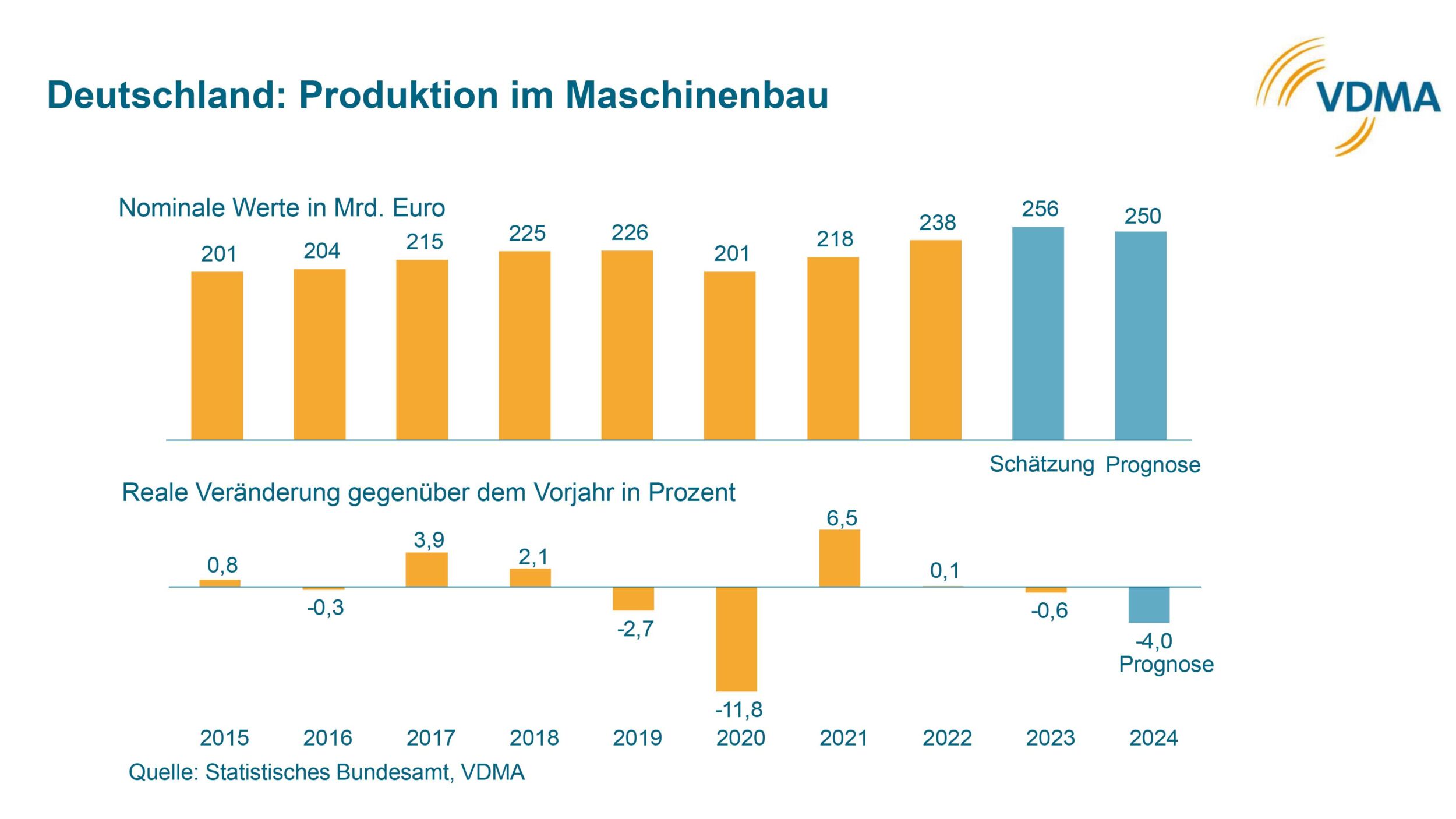

Noffz: Ein Schlüssel in der Vereinfachung der Systeme ist es, diese in verschiedene Funktionseinheiten zu zerlegen. Damit bekomme ich immer einfachere Funktionen in meinen Devices. Dies sehen wir auch in der Bildverarbeitung, weil man immer mehr in den einzelnen Recheneinheiten machen kann. Wir haben uns – getragen vom VDMA IBV – bereits damit auseinandergesetzt, was dies für die Standards in der Bildverarbeitung bedeutet, und sind zu dem Schluss gekommen, dass es drauf ankommt, die Softwaresichtweisen zu vereinheitlichen. Wir brauchen mehr gemeinsame Standards, denn je mehr wir die Systeme kapseln, um so näher kommen wir an die SPS.