Künstlich erzeugte Bilder für die automatische Sichtprüfung

Sensorrealistische Bildsimulation

Bilder für die automatische Sichtprüfung künstlich zu erzeugen, mag auf den ersten Blick unsinnig erscheinen. Man könnte argumentieren, dass die automatische Sichtprüfung ja nur reale Objekte prüft, und von diesen realen Objekten sollten auch reale Bilder vorhanden sein. Eine virtuelle Prüfung von nicht vorhandenen Objekten klingt nach einem Schildbürgerstreich.

Bei näherer Betrachtung ist die Idee, simulierte Bilder in der automatischen Sichtprüfung zu verwenden, allerdings nicht so abwegig. Zwar werden für die tatsächliche Prüfung von Objekten zur Qualitätssicherung immer reale Bilder dieser Objekte verwendet, aber bei der Konzeption, Auslegung und Parametrierung von Bildverarbeitungssystemen gibt es zahlreiche Argumente für die Verwendung simulierter Bilder:

- Soll ein Bildverarbeitungssystem für eine neue Produktionslinie erstellt werden, sind reale Produkte aus dieser Linie noch nicht verfügbar. Ohne reale Objekte lässt sich ein Bildverarbeitungssystem auf normalem Weg aber nur schwer einrichten, da die optimalen Aufnahmeparameter (Kamera-/Beleuchtungspositionen, Blenden und Belichtungszeiten etc.) stark vom Objekt abhängen. Simulierte Bilder können hier helfen, um Visionsysteme zu erstellen, bevor die damit zu prüfenden Objekte verfügbar sind. Dadurch wird eine Qualitätssicherung vom ersten Tag der Produktion an ermöglicht.

- Insbesondere bei der Oberflächeninspektion auf Defekte ist die Vielfalt möglicher Abweichungen vom fehlerfreien Produkt enorm. Um die Defekterkennung auszulegen, sind üblicherweise Musterteile mit unterschiedlicher Ausprägung und Lage von Defekten erforderlich. Die Anzahl notwendiger Musterteile kann dadurch sehr groß werden; darüber hinaus treten manche Defekte bei gut eingestellten Produktionsprozessen praktisch nie auf. Mittels Bildsimulation können solche Defekte in unterschiedlicher Ausprägung und an unterschiedlichen Positionen nahezu beliebig erzeugt werden.

- Für den aktuellen Trend des Deep Learning mittels künstlicher neuronaler Netze werden in der Trainingsphase möglichst viele Bilder als Beispieldaten benötigt, wobei diese Bilder auch noch mit der tatsächlichen Qualitätseinstufung (Ground Truth) versehen sein müssen. Die Erstellung von solchen annotierten Datensätzen mit vielen Hundert oder Tausend Objekten bzw. Bildern mit zugehöriger Qualitätseinstufung verursacht allerdings einen erheblichen Aufwand, der die Anwendung solcher Lernverfahren momentan noch behindert. Die Bildsimulation beseitigt beide Probleme auf einmal: Bei der Simulation lässt sich die Produktqualität vorgeben, und Bilder mit oder ohne Defekte lassen sich in praktisch unbegrenzter Vielfalt und Anzahl erzeugen.

- Mit Hilfe von Simulationen lassen sich Einflüsse auf die Bildgewinnung untersuchen, ohne dass diese in Realität vorhanden sein müssen. So lassen sich die Auswirkungen z.B. von Fremdlicht und Vibrationen, aber auch von Änderungen des Objekts selbst, wie etwa einer Änderung der Oberflächenstruktur oder Farbe auf die automatische Sichtprüfung, einschätzen, bevor diese Veränderungen im Bildaufnahmeprozess tatsächlich eintreten.

Bildsimulation für die IBV

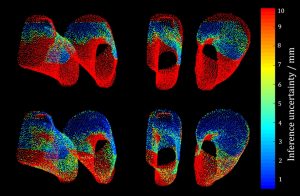

Die meisten Menschen denken bei Bildsimulation an Spezialeffekte, wie sie im Kino oft zu sehen sind. Dort ist die Aufgabe, nicht realisierbare Szenen zu erzeugen – oder schlicht Kosten für teure Requisiten zu sparen. Auch in der Konsumgüterindustrie werden Bildsimulationen zunehmend verwendet, um z.B. Kataloge für Möbelhäuser zu erstellen oder den Kunden schon vor der Auslieferung zu zeigen, wie ihr künftiges Fahrzeug mit der gewählten Farbe und Ausstattung aussehen wird. In allen diesen Anwendungen besteht das Hauptziel darin, dem Betrachter den Eindruck zu vermitteln, dass die reale Szene aufgenommen wurde. Diese Eigenschaft wird üblicherweise als Fotorealismus bezeichnet. Hier hat die Computergrafik in den letzten Jahren große Fortschritte erzielt, so dass der normale Betrachter bei vielen Bildern aus Katalogen keinen Unterschied zu realen Fotoaufnahmen mehr erkennen kann. Die Anforderungen an die Bildsimulation für die industrielle Bildverarbeitung (IBV) sind jedoch andere: Hier geht es nicht darum, dass ein Mensch die Bilder als schön empfinden soll. Das Ziel der Simulation besteht vielmehr darin, alle Effekte der Bildgewinnung zu berücksichtigen, die eine Relevanz für die nachfolgende Bildverarbeitung besitzen können. Dies umfasst z.B. das Spektrum der Beleuchtung (relevant für Fehler der Abbildungsoptik), Effekte der Wechselwirkung zwischen Licht und Oberfläche (etwa bei Laser-Triangulationsverfahren oder aufgrund von Bearbeitungsspuren), Abbildungsfehler der Kameraoptik (Verzeichnungen, chromatische Fehler, Astigmatismen etc.), aber auch Eigenschaften des Kamerasensors (etwa Rauscheinflüsse oder defekte Pixel). Diese Art der Simulation kann als Sensorrealismus bezeichnet werden, da die Szene so simuliert werden soll, wie sie ein realer Sensor erfassen würde. Auch ist es nicht unbedingt erforderlich, die Bilder vollständig und überall in gleicher Detailtreue zu simulieren. Für einen Triangulationssensor ist es beispielsweise ausreichend, nur die projizierte Laserlinie zu berücksichtigen; alles andere ist irrelevant.

verursachten Bearbeitungsspuren (Fräsrillen). (Bild: Fraunhofer IPA)

Sensorrealistisches Simulationswerkzeug

Ansätze einer sensorrealistischen Simulation gibt es bereits seit einigen Jahren. So lässt sich mit manchen Tools etwa die Sensorposition optimieren, indem ein Bild des Objekts aus einer beliebigen Position simuliert wird. Der Bildverarbeiter kann dann entscheiden, ob die relevanten Merkmale des Objekts in hinreichender Qualität erfasst werden. Auch andere Komponenten der Bilderfassung wie z.B. Beleuchtungseinrichtungen oder Abbildungsoptiken lassen sich bereits in der Simulation auswählen. Ein umfassendes sensorrealistisches Simulationswerkzeug für die automatische Sichtprüfung existiert derzeit noch nicht. Für die automatische Sichtprüfung sind zahlreiche Parameter der Beleuchtung, Kamera und auch der Szene und der Umgebung relevant, die alle festgelegt und in geeigneter Weise berücksichtigt werden müssen. Auch wenn computergrafische Verfahren im Prinzip geeignet sind, um die Szene sensorrealistisch darzustellen, so fehlen dennoch passende Tools, um diese Parameter auszuwählen und zu optimieren. Momentane Forschungs- und Entwicklungsarbeiten, u.a. am Fraunhofer IOSB, am Fraunhofer IPA und am KIT, belegen das Potenzial sensorrealistischer Bildsimulation. Noch gibt es keine leicht bedienbare Software für die sensorrealistische Simulation, aber man kann davon ausgehen, dass solche Tools in wenigen Jahren zum normalen Werkzeug für die Erstellung von Bildverarbeitungssystemen gehören werden – so wie heute CAD zur Konstruktion.